経産省 AI利用時の民事責任の手引き公表、2類型で責任の方向性を整理

経済産業省は2026年4月9日、「AI利活用における民事責任の解釈適用に関する手引き〔第1.0版〕」を公表した。AIを用いたサービスやシステムによって第三者に損害が生じた場合の民事責任について、現行法に基づく解釈適用の考え方を体系的に整理したもので、AI開発者・提供者・利用者それぞれの予測可能性を高め、AI利活用の推進と損害発生時の円滑な解決を図ることを目的としている。法的拘束力を持つものではなく、AI開発者・提供者・利用者が自社の責任範囲を予見し、リスク管理や契約設計に役立てるための実務的な指針としての利用を想定している。

生成AIの登場以降、事業領域におけるAI利活用は急速に拡大している。しかし、AIのブラックボックス性や自律性ゆえに、損害発生時にどの主体がどのような責任を負うのかについて裁判例の蓄積や統一的見解が乏しく、責任の所在の不明瞭さがAIの社会実装を躊躇させる一因と指摘されてきた。

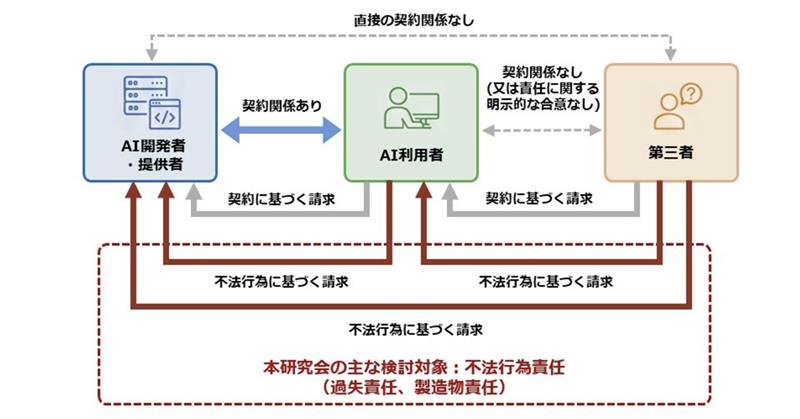

こうした課題を踏まえ、経産省は法学・技術分野の有識者で構成する「AI利活用における民事責任の在り方に関する研究会」(座長:大塚直 早稲田大学法学学術院教授)を設置。不法行為法および製造物責任法の観点から議論を重ね、約1か月間のパブリックコメントを経て今回の「手引き」を取りまとめた。

##

ここに図を挿入

##

「手引き」では、AIの利用形態を「補助/支援型AI」と「依拠/代替型AI」の2類型に整理し、それぞれの責任判断の方向性を示した。「補助/支援型AI」は、判断の補助ないし支援としてのみ用いられ、最終的に人の判断や行動を介在させることが予定される類型だ。AIの機能や利用場面から見て人の判断を代わりに行っているとはいえないケースや、規制法上の理由で人の最終的な判断が要求されるケース、AIの出力が第三者の権利を侵害するリスクを内包し、人の評価・検証が必要なケースが該当する。補助/支援型AIの場合、AI利用者にはAIの利用有無にかかわらず、自身の職業・地位に応じた本来の注意義務のもとで適切な判断や行動を行うことが求められる。AI開発者・提供者の責任は、AIの性能限界や重要なリスク等に関する説明義務が中心となる。

「依拠/代替型AI」は、人の判断や行動を代替する前提で提供され、AIの出力に依拠しながら用いることが予定される類型を指す。人の判断・行動を介在させることでは実現困難な効用が見込まれる(必要性)、同種業務における通常人の作業水準と比較して同等以上の精度や安全性を備えている(精度・安全性)、が要件となる。この類型では、AI利用者の注意義務の対象が、個々の判断そのものから「AIシステムを適正に用いるための体制構築および運用」へと転換する。AI開発者・提供者には、安全性を発揮・維持するための設計上の措置や、リスクコントロールに必要な情報提供などの説明上の措置が求められる。

「手引き」では、配送ルート最適化、画像生成、自律走行ロボットなど7つの想定事例を取り上げ、各主体の責任の方向性を具体的に検討している。補論として、カスタマーサポート用AIエージェントが外部情報を自律的に検索して誤回答を行った事例にも触れ、AIエージェントの責任評価にも「手引き」の枠組みが基礎となるとした。

また、「手引き」は責任の実体面だけでなく、立証や手続に関する論点にも踏み込んでいる。AIの専門技術性や証拠の偏在から、被害者が「過失」や「欠陥」を立証する際の困難が見込まれるとし、文書提出命令の活用や過失・欠陥の事実上の推定など、既存の法理のAI事案への適用可能性を検討した。さらに、AIサービスの開発・提供・利用が国境を跨いで行われるケースの増加を踏まえ、国際裁判管轄、準拠法、外国判決の承認・執行といった国際的な紛争解決の手続上の論点も整理している。

広告掲載のご案内

広告掲載のご案内